Giới thiệu chuyên đề

Các model AI local tập trung trên Ollama

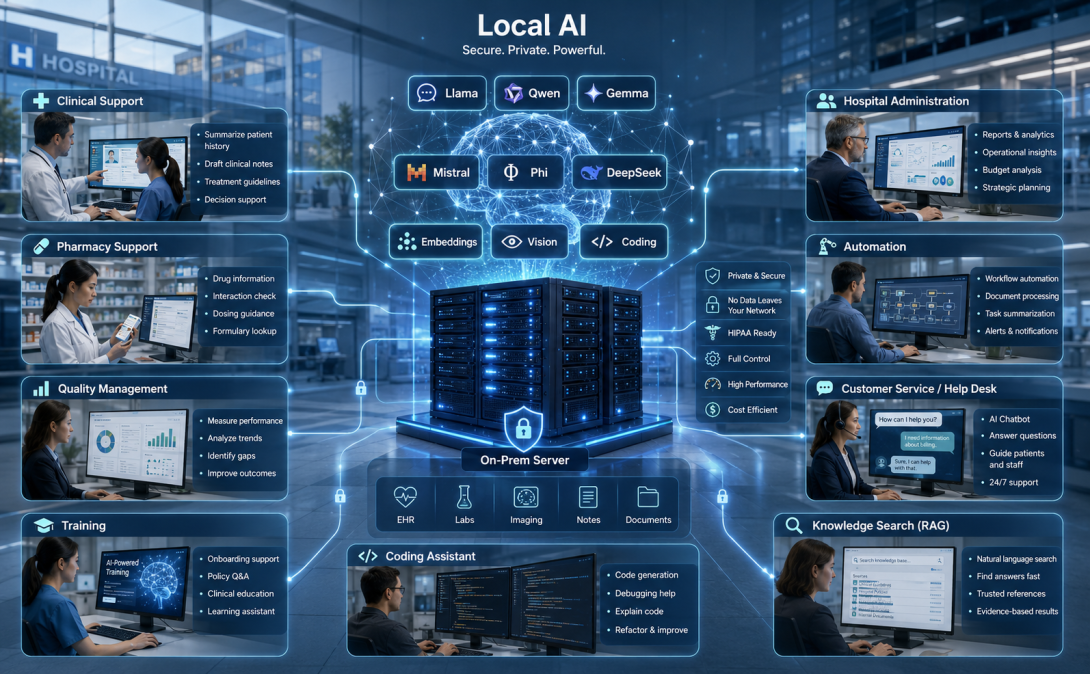

Trong vài năm gần đây, trí tuệ nhân tạo tạo sinh đã phát triển rất nhanh và bắt đầu tác động rõ rệt đến nhiều lĩnh vực, trong đó có y tế. Nếu trước đây AI thường được nhìn nhận chủ yếu như một công cụ hỗ trợ chuyên sâu trong chẩn đoán hình ảnh, xét nghiệm, nghiên cứu thuốc hoặc phân tích dữ liệu lớn, thì hiện nay AI đã mở rộng sang nhiều hoạt động hằng ngày của bệnh viện: soạn thảo văn bản, tóm tắt tài liệu, hỏi đáp quy trình, hỗ trợ đào tạo, phân tích sự cố, xây dựng bảng kiểm, xử lý báo cáo, hỗ trợ lập trình và tự động hóa công việc.

Tuy nhiên, đối với bệnh viện, việc ứng dụng AI không thể chỉ nhìn ở góc độ tiện lợi. Dữ liệu y tế là loại dữ liệu nhạy cảm, liên quan trực tiếp đến người bệnh, nhân viên y tế, hồ sơ bệnh án, quy trình chuyên môn, hoạt động quản trị và trách nhiệm pháp lý của cơ sở khám chữa bệnh. Vì vậy, một câu hỏi rất quan trọng được đặt ra là: bệnh viện có thể khai thác sức mạnh của AI nhưng vẫn bảo đảm chủ động, an toàn, bảo mật và kiểm soát được dữ liệu hay không?

Từ yêu cầu đó, hướng triển khai AI local ngày càng trở nên đáng quan tâm.

AI local có thể hiểu là việc cài đặt và vận hành các mô hình AI trực tiếp trên hạ tầng máy chủ hoặc máy trạm của bệnh viện, thay vì gửi dữ liệu lên các dịch vụ AI bên ngoài. Với cách tiếp cận này, bệnh viện có thể chủ động hơn trong việc quản lý dữ liệu, kiểm soát luồng xử lý, tích hợp với các hệ thống nội bộ và xây dựng các trợ lý AI phục vụ đúng nhu cầu thực tế của mình.

Trong hệ sinh thái AI local hiện nay, Ollama là một trong những công cụ phổ biến, dễ tiếp cận và phù hợp để triển khai thử nghiệm cũng như vận hành các model ngôn ngữ lớn trên máy chủ nội bộ. Ollama cho phép tải, quản lý và chạy nhiều model khác nhau như Llama, Qwen, Gemma, Mistral, DeepSeek, Phi, các model lập trình, model embedding và một số model đa phương thức. Đây là nền tảng thuận lợi để bệnh viện từng bước tiếp cận AI local mà không cần bắt đầu từ những hệ thống quá phức tạp.

Chuyên đề này được xây dựng nhằm giới thiệu một cách có hệ thống về các nhóm model AI local có thể sử dụng trong Ollama, đồng thời phân tích khả năng ứng dụng của từng nhóm model vào hoạt động bệnh viện. Nội dung không đi theo hướng quảng bá công nghệ chung chung, mà tập trung vào câu hỏi thực tế: mỗi loại model có thể giúp gì cho bệnh viện, dùng vào việc gì, phù hợp với bộ phận nào, cần lưu ý giới hạn gì và nên triển khai ra sao cho an toàn?

Trọng tâm của chuyên đề không phải là thay thế con người bằng AI. Trong môi trường bệnh viện, AI cần được nhìn nhận như một trợ lý hỗ trợ công việc, giúp nhân viên y tế, nhân viên quản lý và lãnh đạo bệnh viện tiết kiệm thời gian, chuẩn hóa thông tin, nâng cao chất lượng soạn thảo, hỗ trợ phân tích và tăng khả năng khai thác tri thức nội bộ. Những quyết định chuyên môn, đặc biệt là chẩn đoán, điều trị, chỉ định thuốc, xử trí người bệnh và các vấn đề pháp lý, vẫn phải do con người có thẩm quyền chịu trách nhiệm.

Có thể hình dung AI local trong bệnh viện theo một số nhóm ứng dụng chính.

Thứ nhất là hỏi đáp và khai thác tài liệu nội bộ. Bệnh viện có rất nhiều văn bản, quy trình, quy chế, hướng dẫn chuyên môn, tiêu chí chất lượng, biểu mẫu, kế hoạch, báo cáo và tài liệu đào tạo. Khi được kết hợp với công nghệ RAG, FAISS hoặc vector database, các model AI local có thể giúp nhân viên tìm kiếm và hỏi đáp trên kho tài liệu này nhanh hơn so với cách tra cứu thủ công.

Thứ hai là hỗ trợ soạn thảo và chuẩn hóa văn bản. Các phòng chức năng như Kế hoạch tổng hợp, Quản lý chất lượng, Điều dưỡng, Hành chính quản trị, Tổ chức cán bộ, Công nghệ thông tin, Kiểm soát nhiễm khuẩn, Bảo hiểm y tế, Dược, Vật tư thiết bị y tế đều thường xuyên phải xây dựng kế hoạch, báo cáo, quy trình, bảng kiểm, thông báo, hướng dẫn và tài liệu đào tạo. AI local có thể hỗ trợ tạo bản nháp, chỉnh sửa câu chữ, chuẩn hóa cấu trúc, tóm tắt nội dung và chuyển đổi tài liệu sang nhiều định dạng khác nhau.

Thứ ba là hỗ trợ quản lý chất lượng và an toàn người bệnh. Đây là một hướng ứng dụng rất phù hợp với AI local. Các model có năng lực suy luận có thể hỗ trợ phân tích sự cố, gợi ý nguyên nhân gốc rễ, xây dựng biểu đồ xương cá, đặt câu hỏi 5 Why, đề xuất biện pháp cải tiến, tạo bảng kiểm giám sát và hỗ trợ viết báo cáo tự đánh giá. Dù vậy, các kết quả này chỉ nên được xem là gợi ý ban đầu, cần được hội đồng chuyên môn hoặc bộ phận phụ trách thẩm định.

Thứ tư là hỗ trợ đào tạo và truyền thông nội bộ. AI có thể giúp chuyển hóa một văn bản dài, khó hiểu thành bài giảng, câu hỏi trắc nghiệm, tình huống thảo luận, checklist thực hành hoặc nội dung truyền thông ngắn gọn. Điều này đặc biệt hữu ích trong đào tạo nhân viên mới, cập nhật quy trình, truyền thông an toàn người bệnh, kiểm soát nhiễm khuẩn, giao tiếp ứng xử và giáo dục sức khỏe.

Thứ năm là hỗ trợ công nghệ thông tin và tự động hóa. Các model chuyên về lập trình có thể giúp đội ngũ CNTT bệnh viện viết script, kiểm tra lỗi, tạo API, xử lý dữ liệu CSV/Excel, xây dựng dashboard, hỗ trợ phát triển module Drupal, viết tài liệu kỹ thuật và tự động hóa các công việc lặp lại. Với những bệnh viện đang xây dựng các hệ thống quản trị nội bộ, đây là nhóm ứng dụng có giá trị thực tiễn cao.

Thứ sáu là hỗ trợ xây dựng hệ sinh thái phần mềm quản trị bệnh viện. AI local không nên được triển khai như một công cụ riêng lẻ, mà nên được đặt trong kiến trúc tổng thể gồm: dữ liệu nội bộ, kho tri thức, FAISS/vector database, Ollama model server, API trung gian, chatbot/webapp, hệ thống phân quyền và nhật ký sử dụng. Khi được thiết kế đúng, AI local có thể trở thành một tầng trí tuệ bổ sung cho các phần mềm quản lý bệnh viện hiện có.

Tuy nhiên, để ứng dụng AI local hiệu quả, bệnh viện cần hiểu rằng không có một model duy nhất tốt nhất cho mọi nhiệm vụ. Model nhỏ có thể chạy nhanh, tiết kiệm tài nguyên nhưng năng lực suy luận hạn chế. Model lớn có thể trả lời tốt hơn nhưng đòi hỏi phần cứng mạnh hơn. Model chuyên lập trình phù hợp với CNTT nhưng không nhất thiết phù hợp với văn bản hành chính. Model embedding không dùng để trò chuyện trực tiếp nhưng lại rất quan trọng để xây dựng hệ thống hỏi đáp tài liệu. Model vision có thể xử lý hình ảnh, nhưng không nên dùng tùy tiện cho chẩn đoán hình ảnh y khoa nếu chưa được kiểm định và thẩm định chuyên môn.

Vì vậy, chuyên đề này sẽ tiếp cận các model AI local theo hướng phân nhóm chức năng, bao gồm:

- Nhóm model tổng quát, dùng cho hỏi đáp, soạn thảo và tóm tắt.

- Nhóm model suy luận, dùng cho phân tích vấn đề và hỗ trợ cải tiến.

- Nhóm model lập trình, dùng cho CNTT và tự động hóa.

- Nhóm model embedding, dùng cho RAG, FAISS và kho tri thức bệnh viện.

- Nhóm model vision/multimodal, dùng cho xử lý hình ảnh, biểu mẫu và tài liệu scan.

- Nhóm model nhẹ, dùng cho máy trạm hoặc tác vụ đơn giản.

- Nhóm model lớn, dùng cho máy chủ AI và các bài toán phức tạp hơn.

Mỗi nhóm model sẽ được giới thiệu theo cùng một logic: model là gì, điểm mạnh là gì, hạn chế là gì, phù hợp với tác vụ nào và có thể ứng dụng vào hoạt động bệnh viện ra sao. Cách trình bày này giúp người đọc không bị sa vào quá nhiều thuật ngữ kỹ thuật, nhưng vẫn có đủ cơ sở để lựa chọn model phù hợp với nhu cầu thực tế.

Đối với bệnh viện, triển khai AI local không chỉ là câu chuyện cài đặt một phần mềm hoặc tải một model về chạy thử. Đây là một quá trình bao gồm lựa chọn bài toán đúng, chuẩn bị dữ liệu, thiết kế quy trình sử dụng, kiểm soát rủi ro, đào tạo người dùng, đánh giá chất lượng đầu ra và từng bước tích hợp vào hệ thống quản trị. Nếu triển khai vội vàng, AI có thể tạo ra thông tin sai, gây nhầm lẫn, làm tăng rủi ro chuyên môn hoặc tạo tâm lý phụ thuộc. Ngược lại, nếu triển khai có kiểm soát, AI local có thể trở thành một công cụ rất hiệu quả để nâng cao năng suất, chuẩn hóa hoạt động và hỗ trợ chuyển đổi số trong bệnh viện.

Một hướng đi phù hợp là bắt đầu từ các bài toán ít rủi ro nhưng có giá trị cao, chẳng hạn như hỏi đáp quy trình nội bộ, tóm tắt văn bản, hỗ trợ soạn thảo báo cáo, tạo bảng kiểm, hỗ trợ đào tạo, tra cứu tiêu chí chất lượng, hỗ trợ CSKH và hỗ trợ CNTT. Sau khi hệ thống vận hành ổn định, bệnh viện có thể mở rộng sang các bài toán phức tạp hơn như phân tích sự cố, quản trị rủi ro, phân tích dữ liệu chất lượng, hỗ trợ nghiên cứu khoa học và tích hợp sâu hơn với các phần mềm nội bộ.

Chuyên đề này hướng đến một quan điểm thực dụng: AI local không phải là mục tiêu cuối cùng, mà là một công cụ để bệnh viện quản trị tốt hơn, làm việc hiệu quả hơn và phục vụ người bệnh an toàn hơn. Muốn đạt được điều đó, bệnh viện cần kết hợp đồng thời năm yếu tố: chuyên môn, quản trị, công nghệ, AI và tự động hóa. Trong đó, Ollama và các model AI local là một thành phần quan trọng giúp bệnh viện từng bước xây dựng năng lực AI nội bộ, phù hợp với điều kiện hạ tầng, nhân lực và yêu cầu bảo mật của mình.

Nội dung các phần tiếp theo sẽ lần lượt giới thiệu từng nhóm model thường dùng trong Ollama, phân tích khả năng ứng dụng vào bệnh viện và đề xuất cách lựa chọn model theo từng bài toán cụ thể. Đây sẽ là nền tảng để bệnh viện không chỉ “dùng thử AI”, mà tiến tới xây dựng một hệ thống AI local có định hướng, có kiểm soát và có giá trị thực tiễn trong quản trị bệnh viện.

MỤC LỤC

1. Mở đầu

1.1. Vì sao bệnh viện cần quan tâm đến các model AI local

1.2. Khác biệt giữa AI cloud và AI local trong môi trường bệnh viện

1.3. Vai trò của model AI trong hệ sinh thái số hóa bệnh viện

1.4. Phạm vi chuyên đề: chỉ tập trung vào các model có thể dùng qua Ollama

1.5. Nguyên tắc lựa chọn model cho bệnh viện: bảo mật, chi phí, hiệu năng, tiếng Việt, khả năng tích hợp

Ollama hiện có thư viện model rất rộng, bao gồm các nhóm model ngôn ngữ, lập trình, reasoning, embedding và vision/multimodal; thư viện chính thức cũng đang cập nhật các model mới như Gemma, MedGemma, Qwen và nhiều dòng khác.

2. Phân loại model AI local dùng trong bệnh viện

2.1. Model ngôn ngữ tổng quát

2.2. Model suy luận chuyên sâu

2.3. Model lập trình và hỗ trợ kỹ thuật

2.4. Model embedding dùng cho RAG và FAISS

2.5. Model vision/multimodal

2.6. Model y khoa hoặc định hướng y sinh

2.7. Model nhỏ, nhẹ, phù hợp máy chủ nội bộ hoặc máy trạm

2.8. Model lớn, chất lượng cao, phù hợp máy chủ GPU mạnh

3. Nhóm model Llama

3.1. Giới thiệu chung về dòng Llama

3.2. Các biến thể Llama thường gặp trong Ollama

3.3. Điểm mạnh của Llama: tổng quát, ổn định, dễ dùng

3.4. Hạn chế của Llama khi dùng trong bệnh viện

3.5. Khả năng ứng dụng trong bệnh viện

3.5.1. Trợ lý hỏi đáp nội bộ

3.5.2. Tóm tắt văn bản hành chính, quy trình, quy định

3.5.3. Soạn thảo văn bản quản trị bệnh viện

3.5.4. Hỗ trợ phân tích báo cáo, kế hoạch, biên bản

3.5.5. Trợ lý cho lãnh đạo bệnh viện và phòng chức năng

4. Nhóm model Qwen

4.1. Giới thiệu chung về dòng Qwen

4.2. Các biến thể Qwen trong Ollama

4.3. Điểm mạnh: đa ngôn ngữ, tiếng Việt tương đối tốt, reasoning và coding tốt

4.4. Hạn chế khi triển khai trong bệnh viện

4.5. Khả năng ứng dụng trong bệnh viện

4.5.1. Trợ lý tiếng Việt cho nhân viên bệnh viện

4.5.2. Hỏi đáp văn bản quy định, quy trình, hướng dẫn

4.5.3. Phân tích biểu mẫu, bảng kiểm, nội dung đánh giá chất lượng

4.5.4. Hỗ trợ xây dựng chatbot nội bộ

4.5.5. Hỗ trợ lập trình module, script, API, Drupal, Python

Qwen là một trong các dòng model nổi bật trong Ollama; trang chính thức của Ollama có các model Qwen mới như Qwen3.5, còn trang Qwen3 mô tả năng lực về coding, toán và năng lực tổng quát.

5. Nhóm model Gemma

5.1. Giới thiệu chung về dòng Gemma

5.2. Các biến thể Gemma trong Ollama

5.3. Điểm mạnh: nhẹ, hiệu quả, phù hợp triển khai nội bộ

5.4. Hạn chế khi dùng cho tác vụ chuyên sâu

5.5. Khả năng ứng dụng trong bệnh viện

5.5.1. Trợ lý nội bộ chạy trên máy chủ cấu hình vừa

5.5.2. Hỗ trợ tóm tắt nhanh văn bản ngắn

5.5.3. Hỗ trợ nhân viên tra cứu quy trình thường quy

5.5.4. Chatbot phục vụ đào tạo nội bộ

5.5.5. Hỗ trợ các tác vụ đơn giản cần tốc độ phản hồi nhanh

Ollama mô tả Gemma 4 là nhóm model phù hợp cho reasoning, agentic workflow, coding và multimodal understanding; đây là dấu hiệu cho thấy Gemma không chỉ là model nhẹ mà còn đang phát triển theo hướng đa năng.

6. Nhóm model Mistral và Mixtral

6.1. Giới thiệu chung về Mistral

6.2. Giới thiệu chung về Mixtral và mô hình Mixture-of-Experts

6.3. Điểm mạnh: tốc độ, hiệu quả, khả năng xử lý văn bản dài

6.4. Hạn chế về tiếng Việt và kiến thức chuyên ngành y tế

6.5. Khả năng ứng dụng trong bệnh viện

6.5.1. Tóm tắt tài liệu dài

6.5.2. Phân tích quy chế, quy trình, hướng dẫn chuyên môn

6.5.3. Hỗ trợ xây dựng tài liệu đào tạo

6.5.4. Hỗ trợ rà soát văn bản quản trị

6.5.5. Hỗ trợ hệ thống RAG nội bộ

7. Nhóm model DeepSeek

7.1. Giới thiệu chung về DeepSeek

7.2. DeepSeek dạng chat, coder và reasoning

7.3. Điểm mạnh: suy luận, phân tích logic, lập trình

7.4. Hạn chế: tốc độ, yêu cầu tài nguyên, kiểm soát câu trả lời

7.5. Khả năng ứng dụng trong bệnh viện

7.5.1. Phân tích tình huống quản trị phức tạp

7.5.2. Hỗ trợ xây dựng thuật toán kiểm tra dữ liệu

7.5.3. Hỗ trợ lập trình hệ thống quản lý chất lượng

7.5.4. Hỗ trợ phân tích nguyên nhân gốc rễ sự cố

7.5.5. Hỗ trợ thiết kế quy trình cải tiến chất lượng

DeepSeek là một trong các dòng model phổ biến trong hệ sinh thái Ollama; nhiều tài liệu chọn model Ollama năm 2026 vẫn xếp DeepSeek-R1 vào nhóm mạnh về reasoning.

8. Nhóm model Phi

8.1. Giới thiệu chung về dòng Phi

8.2. Đặc điểm của model nhỏ nhưng có năng lực suy luận tốt

8.3. Điểm mạnh: gọn nhẹ, phù hợp tài nguyên hạn chế

8.4. Hạn chế: không phù hợp tác vụ quá dài hoặc quá chuyên sâu

8.5. Khả năng ứng dụng trong bệnh viện

8.5.1. Trợ lý cá nhân cho nhân viên

8.5.2. Hỏi đáp nhanh các nội dung đơn giản

8.5.3. Tóm tắt ngắn thông báo, văn bản, email

8.5.4. Hỗ trợ máy trạm hoặc máy chủ nhỏ

8.5.5. Ứng dụng trong các điểm làm việc không cần model lớn

9. Nhóm model chuyên lập trình

9.1. Qwen Coder

9.2. CodeLlama

9.3. CodeGemma

9.4. StarCoder

9.5. DeepSeek Coder

9.6. Khả năng ứng dụng trong bệnh viện

9.6.1. Hỗ trợ lập trình Drupal module

9.6.2. Hỗ trợ viết API kết nối HIS, LIS, PACS, EMR

9.6.3. Hỗ trợ viết script Python xử lý dữ liệu

9.6.4. Hỗ trợ kiểm tra lỗi SQL, PHP, JavaScript

9.6.5. Hỗ trợ tự động hóa báo cáo, dashboard, export Excel

9.6.6. Hỗ trợ đội CNTT bệnh viện bảo trì hệ thống nội bộ

10. Nhóm model embedding

10.1. Khái niệm model embedding

10.2. Vai trò của embedding trong RAG và FAISS

10.3. Nomic Embed Text

10.4. BGE / BGE-M3

10.5. MxBAI Embed Large

10.6. Các tiêu chí chọn embedding model cho bệnh viện

10.7. Khả năng ứng dụng trong bệnh viện

10.7.1. Tạo kho tri thức văn bản bệnh viện

10.7.2. Tìm kiếm thông minh quy trình, quy định, hướng dẫn

10.7.3. Hỏi đáp trên tài liệu nội bộ

10.7.4. Truy xuất văn bản pháp luật, thông tư, nghị định

10.7.5. Xây dựng chatbot chuyên ngành theo từng khoa/phòng

11. Nhóm model vision và multimodal

11.1. Khái niệm model vision/multimodal

11.2. LLaVA

11.3. BakLLaVA

11.4. Moondream

11.5. Qwen-VL / Qwen multimodal

11.6. Llama Vision

11.7. Gemma multimodal

11.8. Khả năng ứng dụng trong bệnh viện

11.8.1. Đọc hình ảnh biểu mẫu, ảnh chụp tài liệu

11.8.2. Hỗ trợ mô tả ảnh hành chính, ảnh hiện trường 5S

11.8.3. Hỗ trợ kiểm tra bố trí, biển báo, khu vực làm việc

11.8.4. Hỗ trợ đào tạo nhận diện tình huống an toàn người bệnh

11.8.5. Giới hạn quan trọng: không thay thế bác sĩ chẩn đoán hình ảnh

12. Nhóm model y khoa hoặc định hướng y sinh

12.1. Khái niệm model y khoa local

12.2. MedGemma

12.3. BioMistral

12.4. Các model y sinh khác có thể chạy local

12.5. Điểm mạnh: ngôn ngữ y khoa, thuật ngữ chuyên môn

12.6. Hạn chế: rủi ro sai lệch, không thay thế quyết định lâm sàng

12.7. Khả năng ứng dụng trong bệnh viện

12.7.1. Hỗ trợ đọc hiểu tài liệu y khoa

12.7.2. Hỗ trợ đào tạo, nghiên cứu, tổng quan tài liệu

12.7.3. Hỗ trợ chuẩn hóa thuật ngữ chuyên môn

12.7.4. Hỗ trợ xây dựng nội dung truyền thông giáo dục sức khỏe

12.7.5. Hỗ trợ chất lượng lâm sàng ở mức tham khảo, không ra y lệnh

Ollama hiện có MedGemma 1.5 trong thư viện model chính thức, được mô tả là model y khoa có hỗ trợ vision ở bản 4B.

13. Nhóm model nhỏ, nhẹ cho máy chủ bệnh viện

13.1. Vì sao bệnh viện cần model nhỏ

13.2. Gemma bản nhỏ

13.3. Phi bản nhỏ

13.4. Qwen bản nhỏ

13.5. Llama bản nhỏ

13.6. Tiêu chí lựa chọn model nhỏ

13.7. Khả năng ứng dụng trong bệnh viện

13.7.1. Chatbot nội bộ tốc độ cao

13.7.2. Hỗ trợ các phòng ban không có GPU mạnh

13.7.3. Tự động hóa tác vụ văn phòng

13.7.4. Phân loại câu hỏi, phân tuyến yêu cầu

13.7.5. Tóm tắt nội dung ngắn

14. Nhóm model lớn cho máy chủ GPU mạnh

14.1. Khi nào bệnh viện cần model lớn

14.2. Llama bản lớn

14.3. Qwen bản lớn

14.4. DeepSeek bản lớn

14.5. Mixtral/MoE

14.6. Yêu cầu phần cứng, VRAM, RAM, lưu trữ

14.7. Khả năng ứng dụng trong bệnh viện

14.7.1. Trợ lý quản trị bệnh viện cấp cao

14.7.2. Phân tích tài liệu dài và phức tạp

14.7.3. Hỗ trợ xây dựng chiến lược, kế hoạch, đề án

14.7.4. Hỗ trợ nghiên cứu khoa học và cải tiến chất lượng

14.7.5. Hỗ trợ phân tích dữ liệu kết hợp RAG

15. So sánh định hướng sử dụng các model trong bệnh viện

15.1. Model phù hợp cho hỏi đáp nội bộ

15.2. Model phù hợp cho tiếng Việt

15.3. Model phù hợp cho RAG và FAISS

15.4. Model phù hợp cho lập trình

15.5. Model phù hợp cho văn bản dài

15.6. Model phù hợp cho reasoning

15.7. Model phù hợp cho hình ảnh và tài liệu scan

15.8. Model phù hợp cho máy chủ GPU 16GB

15.9. Model phù hợp cho CPU/RAM lớn

15.10. Model phù hợp cho thử nghiệm trước khi triển khai chính thức

16. Khả năng ứng dụng theo nhóm hoạt động bệnh viện

16.1. Quản lý chất lượng bệnh viện

16.2. Kế hoạch tổng hợp

16.3. Điều dưỡng

16.4. Kiểm soát nhiễm khuẩn

16.5. Dược lâm sàng và thông tin thuốc

16.6. Vật tư thiết bị y tế

16.7. Hành chính quản trị

16.8. Tài chính kế toán

16.9. Công nghệ thông tin

16.10. Truyền thông giáo dục sức khỏe

16.11. Nghiên cứu khoa học

16.12. Đào tạo liên tục

16.13. Chăm sóc khách hàng và công tác xã hội

17. Gợi ý lựa chọn model theo tình huống sử dụng

17.1. Trợ lý hỏi đáp văn bản nội bộ

17.2. Trợ lý soạn thảo văn bản bệnh viện

17.3. Trợ lý phân tích quy trình, quy định

17.4. Trợ lý lập trình cho phòng CNTT

17.5. Trợ lý tìm kiếm tài liệu bằng FAISS/RAG

17.6. Trợ lý đọc biểu mẫu và hình ảnh

17.7. Trợ lý đào tạo nhân viên

17.8. Trợ lý cải tiến chất lượng

17.9. Trợ lý cho lãnh đạo bệnh viện

17.10. Trợ lý nghiên cứu khoa học

18. Những giới hạn cần lưu ý khi dùng model AI local trong bệnh viện

18.1. Không thay thế bác sĩ, điều dưỡng và nhân viên chuyên môn

18.2. Không dùng trực tiếp để ra quyết định lâm sàng nếu chưa kiểm định

18.3. Nguy cơ trả lời sai nhưng có vẻ thuyết phục

18.4. Giới hạn về tiếng Việt, thuật ngữ địa phương và văn bản pháp lý

18.5. Giới hạn về dữ liệu cập nhật

18.6. Giới hạn về phần cứng, tốc độ và dung lượng context

18.7. Cần có cơ chế kiểm duyệt, phân quyền và lưu vết

19. Đề xuất lộ trình chọn model cho bệnh viện

19.1. Giai đoạn 1: thử nghiệm model tổng quát

19.2. Giai đoạn 2: bổ sung embedding model và RAG

19.3. Giai đoạn 3: chọn model chuyên biệt cho từng phòng ban

19.4. Giai đoạn 4: tích hợp với hệ thống nội bộ

19.5. Giai đoạn 5: đánh giá, kiểm định và chuẩn hóa sử dụng

19.6. Giai đoạn 6: xây dựng bộ model chuẩn cho bệnh viện

20. Kết luận

20.1. Model AI local là nền tảng quan trọng cho AI bệnh viện an toàn và chủ động

20.2. Không có một model tốt nhất cho mọi nhiệm vụ

20.3. Bệnh viện cần chọn model theo bài toán, dữ liệu, phần cứng và mức độ rủi ro

20.4. Hướng phát triển: kết hợp model local, RAG, FAISS, phần mềm quản trị và quy trình kiểm soát chất lượng AI